Deepfake video's

De koninklijke familie klaar met de coronamaatregelen? Een nieuw, uitgelekt filmpje gaat viraal. Binnen twee uur al een miljoen keer bekeken op Dumpert en op Twitter staat het binnen de kortste keren bovenaan de Trending-lijst. In de video lijkt koning Willem-Alexander het volgende te zeggen: ‘Máxima, wij doen hier niet meer aan mee. Ik ben die coronamaatregelen en de kleingeestigheid van dit land echt helemaal beu. Weet je wat ik zou willen doen? Dat wij samen met de meiden lekker opnieuw op vakantie naar Griekenland gaan en we niet terug zouden komen tot de eerstvolgende koningsdag.’

Het internet zou op hol slaan. Een hevig online debat zal losbarsten. Aan de ene kant zouden mensen zich afvragen of de koning zijn maatschappelijke verantwoordelijkheid en het saamhorigheidsgevoel volledig kwijt is. Aan de andere kant zouden tegenstanders van het coronabeleid van de overheid zich gesteund voelen door een belangrijke persoon. Voor de een zou de video een reden zijn tot het afschaffen van de monarchie zijn, voor de ander een reden om zich nog meer af te zetten tegen de regering.

Het bovenstaande scenario, inclusief het ‘filmpje’, is volledig verzonnen. Als er wel een uitgelekte video was geweest, had de discussie er vermoedelijk wel uitgezien zoals hierboven beschreven staat. Het publieke debat dat ontstaat bij zo’n controversiële virale video gaat namelijk altijd als eerste over de inhoud van de desbetreffende video.

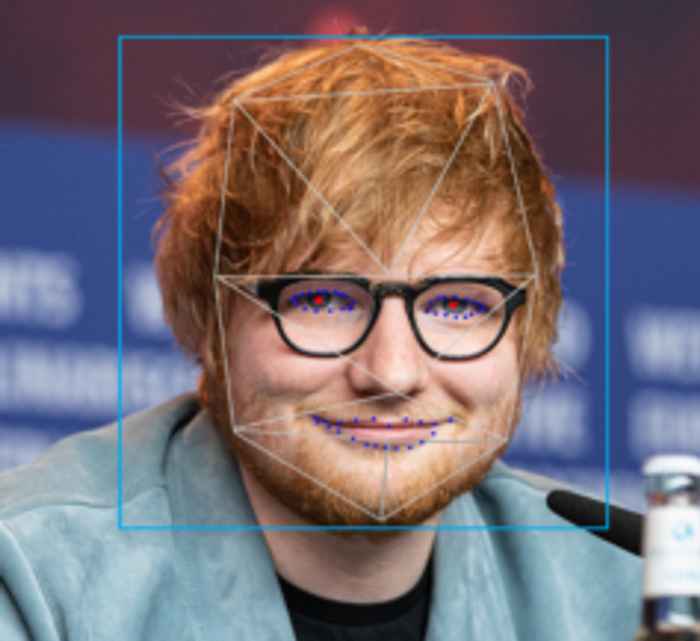

De afgelopen jaren is er een nieuw fenomeen in opkomst. Een fenomeen waarbij technologie en fake news samenkomen: de ‘deepfake’ video. Dit zal het bovenstaande verhaal in een heel ander licht kunnen plaatsen. Deepfake-video’s zijn video’s die gemaakt zijn door een combinatie van een technologie die gezichten in kaart kan brengen en bepaalde technieken uit de kunstmatige intelligentie. Hierdoor kan op basis van filmpjes en foto’s van een persoon, diens gezicht volledig gereconstrueerd worden. Vervolgens wordt het op het gezicht van iemand anders in een video geplaatst. Het resultaat zijn levensechte video’s waarin de ‘gereconstrueerde persoon’ uitspraken doet, die deze persoon nooit heeft gedaan. Deze deepfake-technologie is de afgelopen jaren erg ontwikkeld. Op dit moment is het zelfs onmogelijk om met het blote oog een deepfake-video te herkennen.

Helaas zijn er nog geen manieren om deepfake-video’s te voorkomen en te bestrijden. De technieken waarmee deepfake-video’s opgespoord worden, lopen namelijk achter de ontwikkelingen van de deepfake-technieken zelf aan. Het is een soort kat- en muisspel, waarbij de muis altijd een voorsprong heeft. Doordat de opsporingstechniek achterloopt, voorspellen experts dat video’s in de toekomst onbetrouwbaar worden als informatiebron. Dit zal gebeuren wanneer deepfake-video’s wijdverspreid op het internet aanwezig zijn, terwijl het onmogelijk is om te weten of ze echt zijn of niet.

Bij de opkomst van de deepfake-video’s zal ook het publieke debat over een virale video veranderen. Dit debat zal namelijk volledig gereduceerd worden tot de simpele kwestie of een video echt is, voordat de inhoud überhaupt ter sprake komt. De inhoud van de video wordt dan verwaarloosd, terwijl de discussie die hieruit volgt vaak relevant is. De discussie verkondigt inzicht in de mening van het volk, maar het kan ook maatschappelijke veranderingen in gang zetten.

Als er op dit moment een video uitlekt waarin Willem-Alexander zijn onvrede over het regeringsbeleid uit, zal er een debat losbarsten. Dit debat zal gaan over de dingen die de koning zegt, over de inhoud van de video dus. Als er een moment komt dat video’s niet meer te vertrouwen zijn, zal het echter de echtheid van de video zijn waarover gesproken wordt. Voordat we op dat punt belanden moeten we ons afvragen: Hoe houden we onze nieuwsgeving en de essentiële discussie die daaruit volgt, in stand?

- geschreven door Marloes, Noah, Thijmen & Stijn